早前藍點網提到英偉達推出專用加速卡NVIDIA H100,該加速卡是前代加速卡A100性能的3倍價格也是3倍。

趁著AI熱潮黃仁勳顯然再次抓住熱點:英偉達今天宣布推出針對LLM大型語言模型的專用加速卡H100 NVL。

推出這個新SKU是因為英偉達注意到LLM運行時,超大量的數據會迅速填充顯存,普通版本已經跟不上使用。

所以NVIDIA H100 NVL是迄今為止顯存容量最大的版本,顯存為188GB HBM3 顯存,單卡顯存容量94GB。

專門為LLM設計的新版本:

英偉達在新聞稿中表示 NVIDIA H100 加速卡已經全麵投產,很快英偉達和合作夥伴將向全球企業推出新卡。

H100加速卡在LLM上提供快9倍的AI訓練以及快30倍的AI推理 , 為全球AI企業發揮創造力提供強大動力基礎。

不過今天還有個重點就是H100 NVL版 , 這是英偉達專門麵向大型語言模型推出的新SKU主要就是超大顯存。

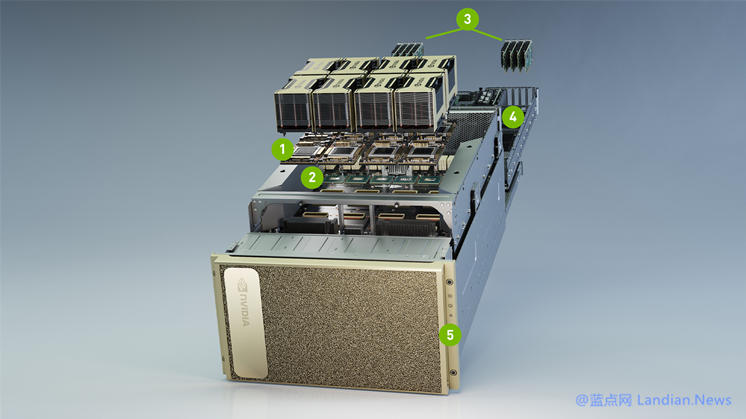

H100 NVL實際上是2張H100合並後的結果 , 主要通過PCIe板進行橋接,每張卡顯存為94GB合計為188GB。

連插槽都是2個PCIe 5.0的因此普通主板都插不上,估計要購買 H100 NVL 的話也得順帶購買配套專用主板。

具體價格方麵目前還不清楚,此前傳聞H100售價 32000 美元約合人民幣22萬元,H100 NVL也必然會翻倍。

以下是H100三種SKU參數對比:

| NVIDIA H100 Accelerator Specification Comparison | |||||

| H100 NVL | H100 PCIe | H100 SXM | |||

| FP32 CUDA Cores | 2 x 16896? | 14592 | 16896 | ||

| Tensor Cores | 2 x 528? | 456 | 528 | ||

| Boost Clock | 1.98GHz? | 1.75GHz | 1.98GHz | ||

| Memory Clock | ~5.1Gbps HBM3 | 3.2Gbps HBM2e | 5.23Gbps HBM3 | ||

| Memory Bus Width | 6144-bit | 5120-bit | 5120-bit | ||

| Memory Bandwidth | 2 x 3.9TB/sec | 2TB/sec | 3.35TB/sec | ||

| VRAM | 2 x 94GB (188GB) | 80GB | 80GB | ||

| FP32 Vector | 2 x 67 TFLOPS? | 51 TFLOPS | 67 TFLOPS | ||

| FP64 Vector | 2 x 34 TFLOPS? | 26 TFLOPS | 34 TFLOPS | ||

| INT8 Tensor | 2 x 1980 TOPS | 1513 TOPS | 1980 TOPS | ||

| FP16 Tensor | 2 x 990 TFLOPS | 756 TFLOPS | 990 TFLOPS | ||

| TF32 Tensor | 2 x 495 TFLOPS | 378 TFLOPS | 495 TFLOPS | ||

| FP64 Tensor | 2 x 67 TFLOPS? | 51 TFLOPS | 67 TFLOPS | ||

| Interconnect | NVLink 4 18 Links (900GB/sec) | NVLink 4 (600GB/sec) | NVLink 4 18 Links (900GB/sec) | ||

| GPU | 2 x GH100 (814mm2) | GH100 (814mm2) | GH100 (814mm2) | ||

| Transistor Count | 2 x 80B | 80B | 80B | ||

| TDP | 700W | 350W | 700-800W | ||

| Manufacturing Process | TSMC 4N | TSMC 4N | TSMC 4N | ||

| Interface | 2 x PCIe 5.0 (Quad Slot) | PCIe 5.0 (Dual Slot) | SXM5 | ||

| Architecture | Hopper | Hopper | Hopper | ||